Den vigtigste konklusion fra den vigtigste rapport fra SXSW

Lanceringen af den årlige Emerging Tech Trend-rapport, på sit nu 17. år, er en af de helt store begivenheder på SXSW-konferencen i Austin, Texas. Det er nemlig altid både interessant og overraskende, hvad trendrapportens forfatter, Amy Webb, har set og sætter fokus på netop i år. Selve rapporten er lidt af en moppedreng på tæt på tusind sider med hele 695 trends set i 95 forskellige scenarier, brudt ned i hele 16 sektioner, som spænder over alt fra biotek til rumfart.

Læs rapportens Executive Summary her.

Læs hele Emerging Tech Trend Report her.

Læs mere om What We See – Future Today Institute

Her kan du se og høre trendrapportens forfatter, Amy Webb, fremlægge og diskutere 2024-rapportens konklusioner på den årligt tilbagevendende lancering af Emerging Tech Trend Report på SXSW.

Rapporten er, i sin enorme grundighed, altid et imponerende stykke arbejde. Et godt overblik over, hvad der sker inden for tech lige nu, hvor vi kommer godt rundt om de 695 trends. En tech-disruption, som er ekstremt velbeskrevet, fordi rapporten meget pædagogisk er bygget op som sektoranalyser i forhold til forskellige teknologier.

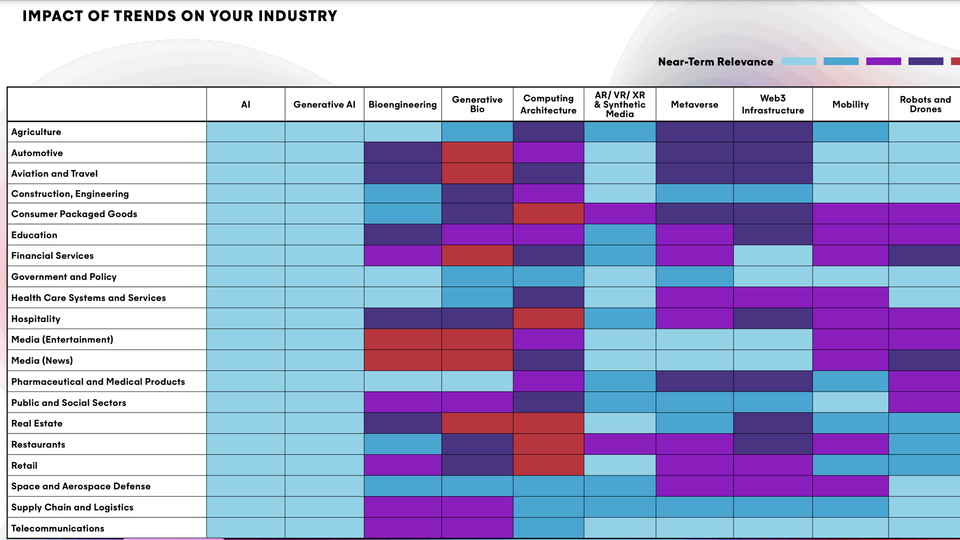

Ganske illustrativt indeholder rapporten derfor altid følgende pædagogiske matrix kreeret med sektorer versus teknologier versus påvirkning. Her kan man så se, hvor hurtigt og i hvor høj grad de enkelte sektorer bliver påvirket af de nye teknologier og hvordan.

Her er en illustrativ model over brancher versus teknologien versus påvirkning på lang og kort sigt.

Som mange andre spår Amy Webb, at AI vil transformere alt og alle industrier. Med et kækt ordspil på ChatGPT (Chat Generative Pre-trained Transformer) kalder hun derfor AI en generel transformativ teknologi.

AI er nu sulten efter sanse- og kropsdata

AI står dog ikke alene, fordi bioteknologiske opfindelser i et netværk af intelligente sensorer vil påvirke og forme vores liv i tæt samspil med den nye kunstige intelligens. Pointen er, ifølge Webb, at AI så at sige vil ”spise” virkelighedens datakilder og smelte sammen med biologi i jagten efter mere og bedre data.

AI vil, ifølge fremtidsforskeren, bevæge sig videre og væk fra blot tekst og billeder. For hvis AI-teknologien skal blive bedre, har den brug for bedre og flere datakilder udover tekst og billeder. Her er den nye og næste frontlinje sansedata og kropsdata.

Fremtiden er en alting-til-alting-AI

Udviklingen af AI vil derfor, ifølge Amy Webb, betyde, at tekstprompts ikke længere er en universel nøgle og kommando til andre udtryksformer.

På langt sigt vil vi udvikle en alting-til-alting-AI, hvor alt kan oversættes til alt fra alt med få eller ingen transaktionsomkostninger. På kort sigt vil vi få flere og bedre redskaber til at skrive AI-prompts, så brugen af AI ikke står og falder med den enkeltes evne til at skrive disse kryptiske AI-kommandoer.

Her vil AI snart kunne hjælpe os fra de vage konceptideer til konkrete løsninger. Hvad Webb kalder det nye koncept-til-konkret-AI-framework og -model.

Zero UI-AI vil erstatte mobil- og computerinterface

Interfacet mellem AI og mennesker er derfor også på vej væk fra telefon og computer til at være mere usynligt baseret på video, lyd og gestik. Hvad eksperterne sammen med Webb kalder Zero UI-AI, hvor AI er en infrastruktur, som er usynlig. Her fremhæver Webb den lille AI-pin-clip med kamera og sensorer som et godt bud på fremtidens grænseflade mellem menneske og computer. En teknologi og et firma, vi også har beskrevet ganske udførligt her på Kforum.

De store AI-sprogmodeller vil, ifølge Future Today-rapporten, blive afløst af såkaldt store handlemodeller, hvor AI vil blive trænet på nye datakilder, som bevægelse, lyde, dufte og andre sensorinput. Fokus er ikke længere på menneskelige frembringelser, men på menneskelige handlinger og væren i verden, digitaliseret og statistisk analyseret.

AI har i dag svært ved menneskelig intentionalitet

Alt sammen for at AI på sigt kan forudsige og efterligne menneskers måde at se og være i verden med krop og intentioner. Det er nemlig i dag meget svært for AI at forstå sociale relationer og handlinger som sociale intentioner. Resultatet er, at den har svært ved at vise social intention på en menneskeligt meningsfuld måde. Jo mere betydning der er indfanget i en kropslig og social intentionalitet og sansning, jo sværere er det for den generative AI at repræsentere. Den kan kun løse dette med flere data fra nye kilder.

Vi er på vej mod large alting-modeller

Hendes forudsigelse er altså, at large language-modeller vil blive erstattet af large alting-modeller. Den slags nye modeller inden for alle mulige områder vil vi se meget mere af i fremtiden. Altså et skifte fra, at AI kan forudsige tekst og billeder, til, at den kan forudsige andre forhold og faktiske handlinger i verden.

AI reducerede i første fase kreativitet i tekst og billede til et statistisk spørgsmål og problem, nu her i anden fase vil den langt mere ambitiøst bruges til at reducere mere komplekse sociale fænomener og interaktioner til sandsynligheder. Hvad vi kender fra forsikringsmatematikken, men nu bliver den slags sandsynligheder noget, vi vil kunne sætte på alle sociale forhold.

Hvornår dør du og jeg, ifølge AI? Og vil vi vide det?

Her er så en sjov dansk vinkel på tidens techtrends, hvor Amy Webb i sin præsentation netop fremhævede de danske forskere, som har bygget en large death-model, som ud fra statistik kan beskrive, hvornår man med størst sandsynlighed vil dø. Uden tvivl både rigtigt og sandsynligt, men har vi lyst til at leve i en verden, hvor vi kender sandsynligheden for alt, fra vores død til fødsel? Dette store moralske og eksistentielle spørgsmål har Amy Webb desværre intet svar på.

Sammenstødet og forskellen mellem AI’s neurale behavioristiske mønstergenkendelse og den menneskelige erkendelse forankret i en kropslig væren i verden

Problemet er, at AI i dag ved alt for lidt om virkeligheden i al dens kompleksitet. Hvad der gør den både dum og underlig set fra et menneskeligt synspunkt. Dels fordi den ikke har en krop, som vi mennesker sanser verden igennem, og dels fordi den kun er trænet på billeder og tekst. Hvad der blot er en meget lille del af verdens samlede mængde af data. Det bagvedliggende problem er her sammenstødet og forskellen mellem AI’s neurale behavioristiske mønstergenkendelse og den menneskelige erkendelse forankret i en kropslig væren i verden og sansninger for et næsten uendeligt virvar af kilder.

Gad vide, hvad AI forudsiger, der vil ske i resten af 2024 –udover hvem der vil dø?

Hvis AI skal udvikle sig og blive bedre, kræver det, at vi bygger en kunstig krop til den, som den kan samle sanseindtryk igennem. AI’en skal så at sige ud at samle data om, hvordan man handler i virkeligheden med en ”krop”. Det betyder, at den har brug for et netværk af nye devices, som kan indsamle disse sansedata og være dens krop.

Her ser Amy Webb et kæmpe potentiale i sammensmeltningen af biologi og AI, hvor vi på sigt vil dyrke nye sanser og neurale netværk.

Hvad Elon Musk Neuralink-teknologi, ifølge fremtidsforskeren, er et godt eksempel på. Hans firma har nemlig udviklet ganske velfungerende hjerneimplantater, hvor hjernen er koblet til digitale sensorer, som dermed kan ”tankelæse” og blive det nye, usynlige interface mellem mennesker, AI og verden. Den perfekte løsning, ifølge fremtidsforskeren, fordi AI har brug for en krop, og kroppen har brug for AI. Skræmmende og fascinerende, og så er året 2024 blot i sin spæde begyndelse. Gad vide, hvad AI forudsiger vil ske i resten af 2024 – udover hvem der vil dø?

Læs mere

What We See – Future Today Institute

Using sequences of life-events to predict human lives | Nature Computational Science

Fra alting til alting AI — Kommunikationsforum

Artificial intelligence can predict events in people’s lives

AI Pin: iPhone-dræberen født og formet af iPhonens forældre — Kommunikationsforum

.jpg&w=384&q=75)